OpenAI sucht einen 'Head of Preparedness' für seinen Standort in San Francisco. Die Position ist im Team 'Safety Systems' angesiedelt, das für die verantwortungsvolle Entwicklung und den Einsatz leistungsfähiger KI-Modelle zuständig ist.

Bedeutung von Preparedness und das Framework

OpenAI versteht unter „Preparedness" das systematische Verfolgen von und Vorbereiten auf Fähigkeiten von Frontier Models, die neue Risiken für schwere Schäden mit sich bringen könnten. Als schwere Schäden definiert das Unternehmen den Tod oder schwere Verletzungen von Tausenden Menschen oder wirtschaftliche Schäden in Höhe von Hunderten Milliarden Dollar.

Die Grundlage für diese Arbeit bildet das Preparedness Framework (PDF) von OpenAI. Es definiert Rahmenbedingungen zur Messung und Abwehr dieser Risiken. Das Framework kategorisiert Risiken in überwachte Bereiche, zu denen biologische und chemische Bedrohungen, Cybersicherheit und die autonome Selbstverbesserung der KI gehören. Zudem definiert das Framework Schwellenwerte für Fähigkeiten. Wenn ein System diese Werte erreicht, schreibt das Regelwerk vor, dass Sicherheitsmaßnahmen das Risiko minimieren müssen, bevor das Modell eingesetzt oder weiterentwickelt wird.

Aufgaben der Position

Der Head of Preparedness verantwortet die technische Strategie und die Umsetzung des Preparedness Frameworks. Zu den zentralen Aufgaben gehört das Erstellen und Koordinieren von Bewertungen der Modellfähigkeiten, Bedrohungsmodellen und Gegenmaßnahmen. Die verantwortliche Person beaufsichtigt das Design von Schutzmaßnahmen in den Hauptrisikobereichen und stellt sicher, dass diese technisch fundiert sind.

Eine weitere Aufgabe ist die Weiterentwicklung des Frameworks, wenn neue Risiken oder externe Erwartungen entstehen. Die Position erfordert die Leitung eines kleinen Teams sowie die Zusammenarbeit mit Forschungs-, Technik-, Produkt- und Policy-Teams, um die Sicherheitsvorgaben in die reale Anwendung zu integrieren.

OpenAI CEO Sam Altman schreibt dazu auf X, KI-Modelle seien inzwischen im Bereich der Computersicherheit so leistungsfähig, dass sie bereits kritische Schwachstellen entdecken könnten. Es brauche ein gutes Verständnis darüber, wie die wachsenden Fähigkeiten missbraucht werden könnten und wie man die potenziellen Nachteile sowohl in den eigenen Produkten als auch in der Welt begrenzen könne.

Auf die Stelle sollten sich laut Altman alle diejenigen bewerben, die dazu beitragen möchten, Cybersicherheit auf höchstem technischen Niveau zu gewährleisten und gleichzeitig Missbrauch auszuschließen, auch für Systeme im Bereich biologischer Fähigkeiten und sich selbst verbessernder Systeme.

Gleichzeitig merkt Altman an, dass es sich um einen Job mit viel Stress handele – und man werde gleich ins kalte Wasser geworfen.

Anforderungen und Vergütung

OpenAI verlangt von Bewerbern tiefe technische Expertise in Bereichen wie maschinelles Lernen, KI-Sicherheit, Evaluierungen und Sicherheit. Kandidaten müssen Erfahrung in der Gestaltung strenger Bewertungen für komplexe technische Systeme sowie in der Führung technischer Teams vorweisen. Die Fähigkeit, klare technische Urteile unter Unsicherheit zu fällen und diese verständlich zu kommunizieren, ist ebenfalls gefordert.

Die Stelle ist mit einem Jahresgehalt von 555.000 US-Dollar dotiert. Zusätzlich bietet das Unternehmen Aktienoptionen an, die ebenfalls einen enormen Gegenwert haben dürften.

Ihr Wartungsspezialist für alle großen Hardware Hersteller

Durch Jahrzehnte lange Erfahrung wissen wir worauf es bei der Wartung Ihrer Data Center Hardware ankommt. Profitieren Sie nicht nur von unserer Erfahrung, sondern auch von unseren ausgezeichneten Preisen. Holen Sie sich ein unverbindliches Angebot und vergleichen Sie selbst.

Weitere Artikel

Anthropic vs. OpenAI: Gut gegen Böse — oder alles nur Schein?

Anthropic gegen OpenAI: Dieser Vergleich polarisiert. Was auf den ersten Blick einfach erscheint, ist jedoch wesentlich komplexer. Zwei KI-Giganten, zwei

Qwen3.6-35B-A3B: Open-Source-Modell mit hoher Leistung

Mit Qwen3.6-35B-A3B liegt ein neues Open-Source-Modell vor, das ähnliche Konkurrenten teilweise deutlich übertrifft. Das neue Qwen3.6-35B-A3B ist ein vollständig als

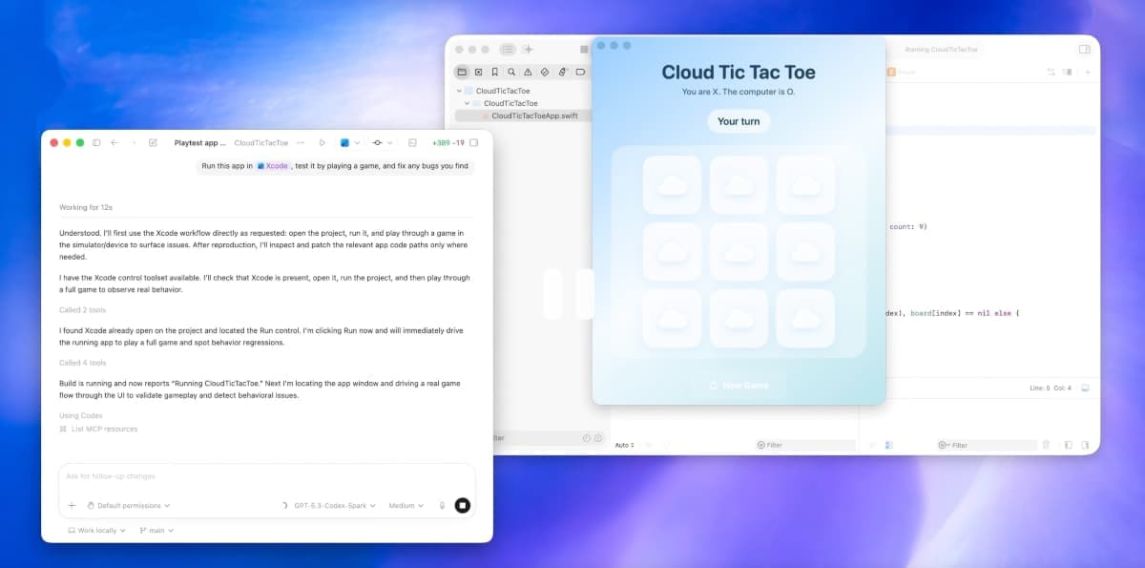

OpenAI erweitert Codex: automer Entwickler, der im Hintergrund arbeiten kann

OpenAI hat ein umfangreiches Update für Codex veröffentlicht. Die Erweiterungen zielen darauf ab, Codex tiefer in den gesamten Software-Entwicklungsprozess zu

Zum Inhalt springen

Zum Inhalt springen